Es ist ein ungewöhnliches Bündnis: Prinz Harry und Herzogin Meghan stehen Seite an Seite mit Apple-Mitgründer Steve Wozniak, dem Papst-Berater Paolo Benanti und dem Trump-Vertrauten Steve Bannon. Was alle eint? Die Angst vor einer Technologie, die noch gar nicht existiert, aber künftig Realität werden könnte.

Sie gehören zu über 800 Personen, die einen offenen Brief unterzeichnet haben, der eine klare Forderung stellt: Stoppt die Entwicklung künstlicher Superintelligenz, und zwar subito. Das Verbot soll erst aufgehoben werden, wenn die Wissenschaft sich einig ist, dass diese Art von Technologie sicher kontrollierbar ist. Hinter dem Aufruf steht das Future of Life Institute, eine US-Organisation für KI-Sicherheit. Organisiert hat den Brief Anthony Aguirre, der Direktor des Instituts. «Die Zeit läuft uns davon», sagt er dem «Time»-Magazin. Denn einige Experten glauben, dass Superintelligenz bereits in ein bis zwei Jahren Realität werden könnte.

«Gibt keine zweite Chance»

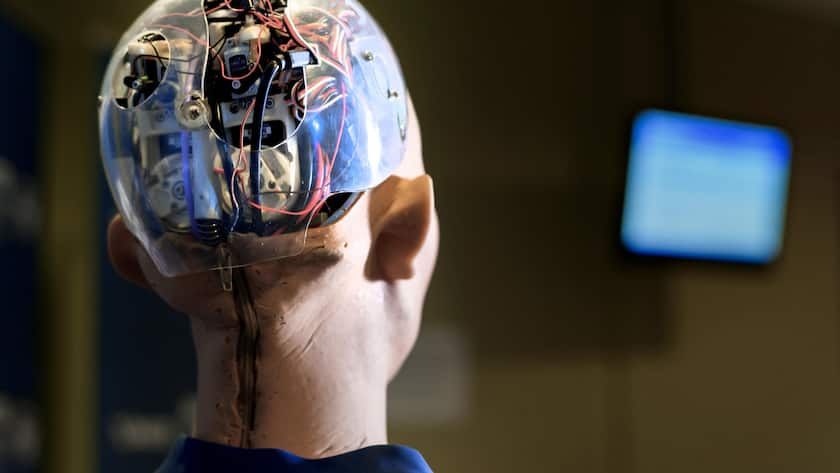

Doch was ist diese Superintelligenz eigentlich? Es ist ein schwammiger Begriff, der KI-Systeme bezeichnet, die Menschen in allen Aufgaben übertreffen. Also nicht nur beim Schachspielen oder Texte schreiben, sondern beim Denken, Planen, Lernen. Firmen wie OpenAI (Hersteller von ChatGPT), Google, Meta und Microsoft forschen daran. Meta-Chef Mark Zuckerberg verkündete im Juli, die Entwicklung von Superintelligenz sei «in Sichtweite».

Das bereitet vielen Sorgen. Unter den Unterzeichnern sind auch Geoffrey Hinton und Yoshua Bengio. Beide gelten als «Väter der modernen künstlichen Intelligenz». Hinton gewann 2024 den Nobelpreis für Physik. Dass ausgerechnet sie vor der Technologie warnen, gibt der Sache Gewicht.

«Wir haben keine zweite Chance», schreibt Prinz Harry in einer Stellungnahme. Der wahre Fortschritt zeige sich nicht darin, wie schnell man vorankomme, sondern wie weise man steuere. Die Befürchtungen reichen weit: von massenhaftem Jobverlust über den Verlust bürgerlicher Freiheiten bis zu Sicherheitsrisiken für ganze Staaten. Im schlimmsten Fall, so die Warnung, könnte die Menschheit ausgelöscht werden.

Zweifel an der Machbarkeit

Doch längst nicht alle sind überzeugt, dass Superintelligenz überhaupt bald möglich ist. Kritiker werfen den Tech-Firmen vor, die Fähigkeiten ihrer Produkte in extremis aufzublasen. Kürzlich behauptete OpenAI, ChatGPT habe ungelöste Matheprobleme geknackt und blamierte sich damit. Mathematiker widersprachen: Der Chatbot hat nämlich lediglich zusammengefasst, was bereits online stand. Darauf löschte der Mitarbeiter von OpenAI seinen Beitrag auf x.com.

Manche sehen in der Superintelligenz-Rhetorik vor allem einen Wettbewerbstrick: Firmen in den USA und China befinden sich in einem Rennen. Wer zuerst behauptet, kurz vor dem Durchbruch zu stehen, lockt Investoren an. Allein dieses Jahr fliessen Hunderte Milliarden Dollar in die KI-Entwicklung.

Anfang 2025 sagte Yann LeCun, Chef KI-Forscher bei Meta, auf die Frage, ob KI in den nächsten zwei Jahren das Niveau eines Menschen erreichen könnte: «Auf keinen Fall, nie und nimmer. Das ist absoluter Bullshit!» Er betonte, dass heute bestehende Large Language Models (LLMs) für Superintelligenz fundamental unzureichend seien und es dafür «vollkommen neue Architekturen» brauche. Kritik kommt also sogar aus den eigenen Reihen.

Ob der Brief etwas bewirkt, ist zudem fraglich. Die IT-Newsplattform techspot.com kommentiert das Unterfangen so: «Letztlich wird der Brief die KI-Firmen wohl kaum veranlassen, die Superintelligenz-Entwicklung zu verlangsamen.» Ein ähnlicher Brief von 2023, den damals auch Elon Musk unterzeichnet hatte, zeigte «wenig bis keine Wirkung».

Dieser Artikel erschien zuerst bei Blick.