In einem offenen Brief fordern Wissenschafter einen Entwicklungsstopp bei künstlicher Intelligenz (KI). Jede Weiterentwicklung einer KI, die mächtiger als Chat GPT 4 werde, sei derzeit zu gefährlich und könnte zum Untergang der Menschheit führen, befürchten die Experten. Dabei arbeitet Open AI, die Firma hinter Chat GPT, schon an Version 5, nachdem die Version 4 vor wenigen Wochen veröffentlicht wurde.

Unter den Prominenten, die den offenen Brief der Wissenschafter unterschrieben haben, sind unter anderem Elon Musk, Steve Wozniak (Mitgründer von Apple), Andrew Yang (ehemaliger Präsidentschaftskandidat der USA) und Yuval Noah Harari. Letzterer ist nicht nur Professor, sondern vor allem für seine Bücher bekannt, unter anderem «Eine kurze Geschichte der Menschheit».

Für Maschinen sind Menschen nur Atome, die auch einer anderen Verwendung zugeführt werden könnten

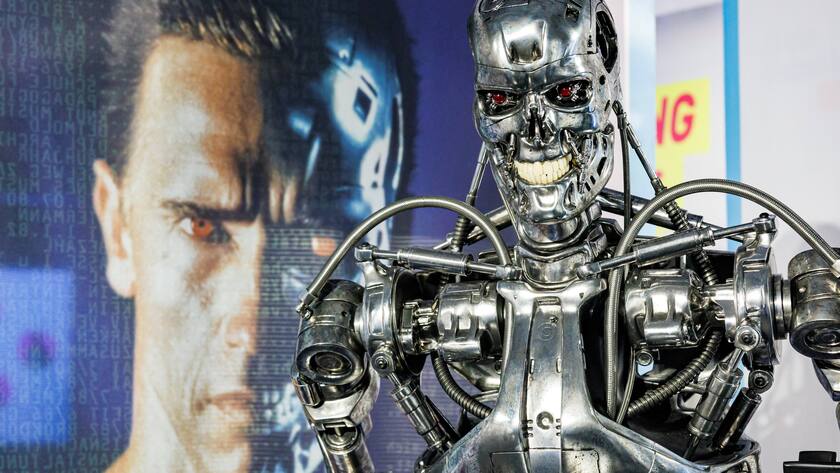

Die Geschichte der Menschheit könnte kurz bleiben, wenn KI sich verselbständigt und die Menschheit eines Tages für überflüssig hält. Das Problem ist, dass die Menschheit der KI derzeit egal ist. Physikalisch gesprochen, sind Menschen für eine KI nur Atome, die auch einer anderen Verwendung zugeführt werden könnten.

Dass sich eine KI um die Existenz von Menschen kümmert, könne im Prinzip in den Code einer KI eingebaut werden, aber derzeit sei man nicht dazu fähig und wisse nicht, wie das gehen solle. Das schreibt Eliezer Yudkowsky im renommierten «Time Magazin». Yudkowsky ist ein Entscheidungstheoretiker, der die Forschung am Machine Intelligence Research Institute leitet. Er selber hat den offenen Brief der Wissenschafter nicht unterschrieben, weil dort nur ein Forschungsstopp von sechs Monaten gefordert wird. Yudkowsky glaubt nicht, dass das reicht.

Im Wettlauf um die Vorherrschaft bei KI geht die Vorsicht vergessen

Im offenen Brief sind die Wissenschafter besorgt über den Wettlauf, den Chat GPT ausgelöst hat. Im Kampf um die Vorherrschaft bei KI würden schnell immer mächtigere Werkzeuge entwickelt. Diese könnten nicht einmal deren Erschaffer verstehen noch kontrollieren. Tatsächlich hat die Firma Open AI schon geplant, dass KI künftig selber neue, noch besser KI entwickeln soll.

Die Wissenschafter schreiben in ihrem offenen Brief weiter, KI sein nun bei allgemeinen Aufgaben wettbewerbsfähig mit Menschen. Wir müssten uns fragen, ob wir das Internet mit Propaganda und Unwahrheiten füllen lassen wollten? Sollen wir alle Jobs wegautomatisieren, sogar jene, die erfüllend sind? Sollen wir Maschinen schaffen, die uns übertrumpfen und überflüssig machen?

Weil schon der nächste Schritt die Menschheit in den Abgrund führen könnte, sollen KI-Weiterentwicklungen gestoppt werden. Denn nun müssten zuerst die bestehenden KI-Systeme sicherer, transparenter, robuster, vertrauenswürdiger und loyaler gemacht werden.

Italien hat Chat GPT blockiert

Kurz nach der Veröffentlichung des offenen Briefes der Wissenschafter hat Italien am Freitag, dem 31. März 2023, Chat GPT blockiert. Als erstes Land in der westlichen Welt. Allerdings nicht aus Angst, dass KI die Weltherrschaft übernehmen könnte, sondern aus Datenschutzgründen. Inzwischen ist Chat GPT aus Italien nicht mehr erreichbar.

Von den Gefahren von KI bliebe Italien trotzdem nicht verschont. Die Wissenschafter warnen, dass bereits der nächste Entwicklungsschritt in eine Zukunft führt, die nicht mehr aufzuhalten wäre – unumkehrbar. Deshalb sei der Stopp zwingend nötig und möglich. Man habe das schon bei anderen Technologien geschafft, etwa beim Klonen von Menschen.

«Wir alle werden sterben»

Lanciert wurde der offene Brief vom Future of Life Institute. In dessen Verwaltungsrat ist etwa Jaan Tallinn, Co-Gründer von Skype. Zu den externen Beratern des Instituts gehören Elon Musk sowie einige Physik- und IT-Professoren. Im Future of Life Institut geht man davon aus, dass moderne Technologie das Leben der Menschen verbessern kann, wenn sie richtig genutzt wird. Wenn nicht, könne sie die Menschheit in die Knie zwingen oder gar ausrotten. Gefahren sieht das Future of Life Institute in vier Bereichen: Biotechnologie, Nuklearwaffen, Klimawandel und künstliche Intelligenz.

Letztere Gefahr beschreibt Yudkowsky in seinem Text im «Time Magazine» unter dem Titel «Pausieren ist nicht genug. Wir müssen das Ganze abschalten». Er beendet den Text so: «Wir sind nicht bereit. Wir sind nicht auf dem besten Weg, in absehbarer Zeit wesentlich besser vorbereitet zu sein. Wenn wir so weitermachen, werden alle sterben, auch Kinder, die sich das nicht ausgesucht und nichts falsch gemacht haben.»

Den offenen Brief der Wissenschafter kann man hier lesen und auch unterschreiben.

Einige aus der Schweiz haben schon unterschrieben. Dazu gehören zwei Wirtschaftsinformatiker vom Schweizer Kreditkartenanbieter Swisscard AECS, der American Express und Credit Suisse gehört. Swisscard AECS managt unter anderem die 1,5 Millionen Kartenverträge der Credit Suisse.